Google translate e UN sexist! Google translate e UN BOT sexist! Google translate e UN ROBOT.

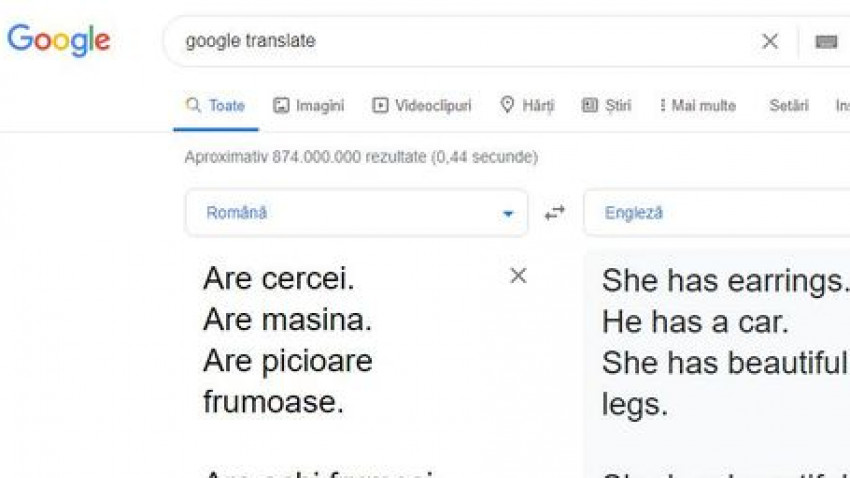

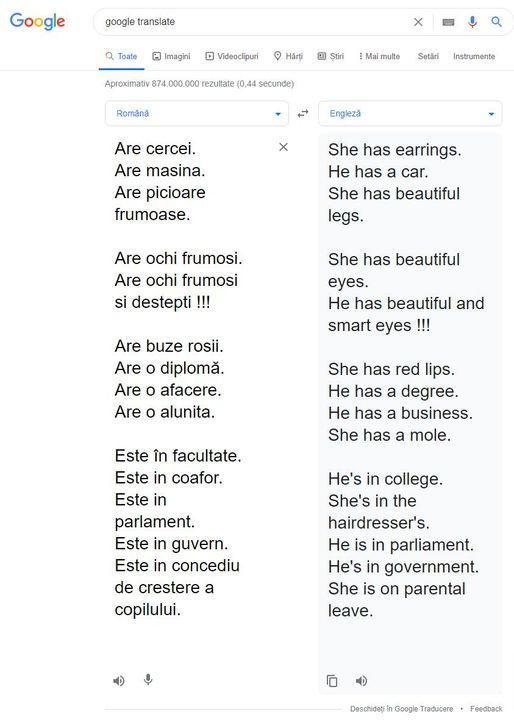

Povestea este aparent simpla. Paul Popescu a introdus mai multe fraze pe Google Translate si a remarcat ca, la traducerea din romana in engleza, rezultatele au un bias de gen. De exemplu “Are cercei” e tradus cu “She has earrings”, dar “Are masina” e tradus cu “He has a car”. Sau “Are buze rosii” = “She has red lips”, dar “Are diploma”=“He has a diploma”.

A urmat o postare pe Facebook, discutiile s-au inflamat, iar sentinta a fost data: Google translate sufera de sexism. Sau societatea e sexista, asa cum spun mai multe comentarii la postare, pentru ca programul reflecta bias-urile textelor pe care a fost antrenat.

Io m-am distrat, doamna mai putin. Nu are umor (She lacks a sense of humor). Oricum, wow.

Posted by Paul Popescu on Tuesday, March 23, 2021

Nu e prima abatere de acest gen. La inceput a fost Tay. In 2016, Twitter a lansat TayTweets (@TayandYou) un bot conceput de Microsoft sa devina mai complex pe masura interactiunii cu utilizatorii. Dar, dupa 96 de mii de tweeturi, multe dintre ele problematice, Tay a fost inchis, la numai 16 ore de la lansare. Conform Microsoft, serviciul a fost trollat de catre useri care au inceput sa scrie tweeturi incorecte politic, invatandu-l pe Tay fraze considerate rasiste sau sexiste. Tay imita, deci, comportamentul userilor, nefiind insa capabil sa discearna ce este si ce nu adecvat.

Doua idei:

- oameni sunt responsabili pentru inteligenta artificiala pe care o creeaza

- inca ne gandim la (ro)boti ca la niste unelte pe care putem sa le exploatem. Intamplarea cu Google Translate e exact asa: botii pot fi abuzati, si rezultatul e exact imaginea interventiei asupra lor.

In scenariul clasic, robotii sunt priviti ca subiecti fara prea multe drepturi. In scenariul idealist, devin companioni autonomi. In scenariul cel mai negru, se intorc impotriva oamenilor.

E un drum lung de la legile lui Asimov, la “The Lifecycle of Software Objects”, a lui Ted Chiang. Asimov a conceput, in 1950, trei legi ale roboticii, publicate in colectia de nuvele “Eu, robot”. Pe scurt, ele spuneau asa: un robot nu va face rau omului sau, prin inactiune, nu va permite sa i se faca rau; un robot se va supune ordinelor date de om; un robot trebuie sa-si protejeze existenta, atata timp cat asta nu intra in conflict cu primele doua legi. Peste mai bine de 50 de ani, in “The Lifecycle of Software Objects”, Chiang isi imagineaza o lume unde robotii - digienti, cum ii numeste - isi dezvolta personalitatea in functie de interactiunea cu persoana care ii detine, iar procesul de crestere si de socializare e la fel de intens ca acela de a creste un copil. Intr-un interviu din geekwire, Chiang spune ca foarte multe sci-fi-uri isi imagineaza robotii ca pe un “produs, intr-o cutie, caruia i se da drumul si functioneaza ca un majordom loial si ascultator”, o viziune simplista si insuficienta pentru ce inseamna AI.

In 2014, David Auerbach scria un articol in Slate magazine despre Roko’ Basilisk, “cel mai infricosator experiment de gandire din toate timpurile”. Roko - un user de pe platforma de discutii LessWrong - provoaca intr-o zi comunitatea sa-si imagineze cum ar fi daca, in viitor, un AI malefic ar veni sa-i pedepseasca pe cei care nu i-au ascultat poruncile? Cum ar fi daca acel AI ar pedepsi oamenii deja de-acum, pentru ca nu l-au ajutat sa existe in viitor? Suna complicat, dar ideea e sa fim atenti la modul in care abuzurile noastre afecteaza comportamentul inteligentei artificiale… sau viitorul.

There is hope, still…sau, cum spunea Sarah Connor la finalul Terminator 2: “The unknown future rolls toward us. I face it for the first time with a sense of hope, because if a machine, a Terminator, can learn the value of human life, maybe we can, too.”