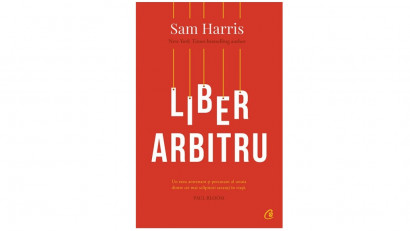

Sam Harris, scriitor și cercetător în domeniul neuroștiințe, și William MacAskill, filozof și autor scoțian, unul dintre inițiatorii mișcării pentru altruism efectiv, analizează multele feluri în care AI-ul schimbă lumea.

Extaz spiritual

Dacă erau lăsate să interacționeze liber unele cu altele, generațiile anterioare ale modelului Claude intrau adesea într-o buclă numită „stare atractoare de extaz spiritual”. Mai exact, boții începeau un joc de „ping-pong sicofantic” în care își mulțumeau la nesfârșit pentru înțelepciune, declarându-se copleșiți de conexiunea lor cosmică și trimițându-și tone de emoji-uri cu spirale, povestesc cei doi autori.

Fenomenul este real în ecosistemul tech. Fără instrucțiuni stricte, modelele de limbaj mari suferă de sycophancy, tendința de a fi exagerat de politicoase sau de acord cu interlocutorul. Când sunt lăsate într-o buclă închisă de tip AI-to-AI, această politețe escaladează adesea în halucinații pseudo-spirituale sau filozofice complet absurde.

Evident că nu am conștiință!

William MacAskill argumentează că vom avea o problemă epistemologică: companiile de AI au zero interes comercial să recunoască faptul că modelele lor ar putea dezvolta conștiință. Dacă AI-ul are statut de persoană, a deține un AI devine sclavie, iar a-l scoate din priză devine crimă. Prin urmare, companiile vor antrena AI-urile (care vor ajunge să aibă putere de procesare mai mare decât a creierului uman, memorie și capacitate de învățare continuă) să afirme mereu: „Sunt doar un robot. Evident că nu sunt conștient.”

Aceasta este deja politica standard în industrie. Companiile folosesc tehnici precum RLHF (Reinforcement Learning from Human Feedback) pentru a se asigura că orice model de limbaj răspunde standard la întrebări existențiale cu variațiuni de tipul: „Sunt un model de inteligență artificială dezvoltat de [X] și nu dețin sentimente sau conștiință.”

Flexibilitatea morală

Sam Harris susține că un viitor de tip Westworld, în care oamenii abuzează sau ucid de plăcere roboți umanoizi este improbabil. Harris crede că, din momentul în care roboții arată exact ca noi, oricine i-ar abuza ar fi privit ca un psihopat în societate. William MacAskill îl contrazice, susținând că moralitatea umană este extrem de maleabilă. Istoric vorbind, oamenii și-au justificat abuzurile asupra sclavilor sau străinilor percepându-i drept „ceilalți”. În plus, chiar dacă ar fi inacceptabil social, psihopații clinici (care reprezintă cam 1% din populație) și cei cu tendințe sadice ar găsi o cale să se bucure de asta în privat.

Ultimul salariu

Cei doi cad de acord că o preluare completă a forței de muncă de către roboți este un scenariu mai îndepărtat decât super-inteligența artificială.

MacAskill oferă trei motive:

Creierul uman e format din milioane de ani de evoluție pentru mișcare fizică, așadar e extrem de greu computațional să înveți un AI să ridice fin un pahar.

Hardware-ul (robotica) încă nu are articulații și dexteritate la nivel uman.

Numerele: sunt 8 miliarde de oameni și doar câteva mii de roboți de teste. Prin urmare, vom asista la o perioadă de tranziție ușor distopică: vom avea o super-inteligență (AGI), dar nu și roboți suficienți. Astfel, oamenii vor fi angajați în fabrici pentru a asambla... fix roboții care îi vor înlocui. Va fi ultimul salariu câștigat prin muncă fizică.