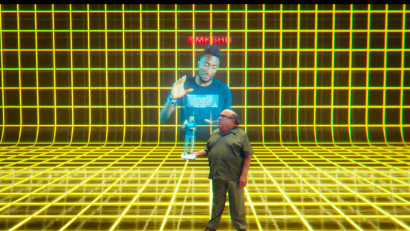

Până acum, am tot stat de vorbă cu boții. Le-am dat prompturi, ne-au dat texte, i-am întrebat despre viață, rețete, planificarea vacanțelor și multe altele. Dar era pur conversațională apune, și începe o nouă etapă, agentică. Un material IBM Technology arată cum agenții AI fac tranziția de la simpli asistenți de dialog la manageri de proiect autonomi capabili să automatizeze fluxurile de lucru.

În interacțiunile obișnuite, modelul lingvistic oferă informația, iar utilizatorii umani o folosesc. Acum, agenții AI combină inteligența modelului cu o capacitate integrată de a acționa autonom. Pentru a înțelege exact cum funcționează lucrurile, materialul IBM arată anatomia proiectului open-source numit OpenClaw.

Bucla Agentică

Spre deosebire de un chatbot cu o rută liniară, un agent rulează într-o arhitectură recurentă. Când primește un task, el asamblează un context format din istoric, memorie pe termen lung și setul de unelte disponibile.

Odată ce contextul e format, LLM-ul raționează dacă are nevoie de o unealtă. Dacă e necesar, acționează (caută pe web, citește un fișier, apelează un API), obține rezultatul și îl trimite înapoi în fereastra sa de analiză. Procesul continuă circular până când sarcina este complet rezolvată.

OpenClaw este dat ca exemplu de proiect lansat la finele anului 2025, ce rulează complet local via NodeJS. Sistemul folosește un principiu "Hub and Spoke", nucleul fiind un Gateway centralizat care gestionează sesiunile. Pentru a putea discuta cu el pe Slack, Discord sau iMessage, agentul se folosește de adaptoare care preiau varietatea de formaturi externe și le traduc într-un limbaj intern unificat.

Talente & pericole

Agentul este dotat cu foldere cu fișiere markdown ce conțin instrucțiunile de care are nevoie. Secretul este că sistemul injectează inițial doar metadate scurte în spațiul modelului, iar acesta cere varianta completă a instrucțiunii abia la nevoie, pentru a nu sufoca fereastra de context. Așa ajunge AI-ul să folosească instrumente software grele, de la Google Calendar și Trello, până la medii de devops precum Docker.

Puterea de a rula cod și a apela sisteme aduce riscuri majore. O configurare greșită poate transforma asistentul într-un backdoor periculos. Mai grav este riscul de Prompt Injection – situația în care agentul scanează un material necunoscut (ex: un e-mail extern) ce ascunde comenzi malițioase, iar modelul decide să le execute orbește.

Pentru a ține pasul cu viitorul, e nevoie de infrastructuri sigure care să integreze productivitatea alături de o guvernanță etică.